我們在使用百度站長平台的時候,在後台可以看到Robots的身影,那麼Robots.txt文件到底是什麼呢?Robots.txt文件有什麼作用呢?

什麼是Robots.txt文件?

robots是站點與spider溝通的重要渠道,站點通過robots文件聲明該網站中不想被搜索引擎收錄的部分或者指定搜索引擎只收錄特定的部分。請注意,僅當您的網站包含不希望被搜索引擎收錄的內容時,才需要使用robots.txt文件。如果您希望搜索引擎收錄網站上所有內容,請勿建立robots.txt文件。為了避免站長在設置robots文件時出現,百度站長平台特別推出了robots工具,幫助站長正確設置robots。百度Robots工具使用說明:

1、robots.txt可以告訴百度您網站的哪些頁面可以被抓取,哪些頁面不可以被抓取。

2、您可以通過Robots工具來創建、校驗、更新您的robots.txt文件,或查看您網站robots.txt文件在百度生效的情況。

3、Robots工具暫不支持https站點。

4、Robots工具目前支持48k的文件內容檢測,請保證您的robots.txt文件不要過大,目錄最長不超過250個字符。

robots.txt是以什麼形式存在?

robots.txt就是一份網站和搜索引擎雙方簽訂的規則協議書。每一個搜索引擎的蜘蛛訪問一個站點時,它首先爬行來檢查該站點根目錄下是否存在robots.txt。如果存在,蜘蛛就會按照該協議書上的規則來確定自己的訪問范圍;如果沒有robots.txt,那麼蜘蛛就會沿著鏈接抓取。User-agent:該項用於描述搜索引擎蜘蛛的名字。(1)規定所有蜘蛛:User-agent:*;(2)規定某一個蜘蛛:User-agent:BaiduSpider。

Disallow:該項的值用於描述不希望被訪問的一組URL,這個值可以是一條完整的路徑,也可以是路徑的非空前綴,以Disallow項的值開頭的URL不會被 robot訪問。例如"Disallow:/help"禁止robot訪問/help.html、/helpabc.html、/help/index.html,而"Disallow:/help/"則允許robot訪問/help.html、/helpabc.html,不能訪問/help/index.html。"Disallow:"說明允許robot訪問該網站的所有url,在"/robots.txt"文件中,至少要有一條Disallow記錄。如果"/robots.txt"不存在或者為空文件,則對於所有的搜索引擎robot,該網站都是開放的。

Allow:該項的值用於描述希望被訪問的一組URL,與Disallow項相似,這個值可以是一條完整的路徑,也可以是路徑的前綴,以Allow項的值開頭的URL 是允許robot訪問的。例如"Allow:/hibaidu"允許robot訪問/hibaidu.htm、/hibaiducom.html、/hibaidu/com.html。一個網站的所有URL默認是Allow的,所以Allow通常與Disallow搭配使用,實現允許訪問一部分網頁同時禁止訪問其它所有URL的功能。

robots.txt文件用法舉例

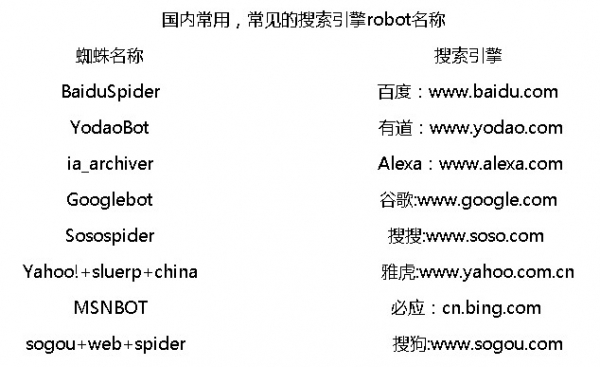

常見搜索引擎robot的名稱

網站誤封Robots該如何處理?

robots文件是搜索生態中很重要的一個環節,同時也是一個很細節的環節。很多站長同學在網站運營過程中,很容易忽視robots文件的存在,進行錯誤覆蓋或者全部封禁robots,造成不必要損失!處理方式:

1.修改Robots封禁為允許,然後到百度站長後台檢測並更新Robots。

2.在百度站長後台抓取檢測,此時顯示抓取失敗,沒關系,多點擊抓取幾次,觸發蜘蛛抓取站點。

3.在百度站長後台抓取頻次,申請抓取頻次上調。

4.百度反饋中心,反饋是因為誤操作導致了這種情況的發生。

5.百度站長後台鏈接提交處,設置數據主動推送(實時)。

6.更新sitemap網站地圖,重新提交百度,每天手工提交一次。