網站Robots.txt文件,是網站與搜索引擎交流的通用協議,通過Robots協議的設置告訴搜索引擎哪些頁面可以抓取,哪些頁面不能抓取:一方面可以做網站安全的防護,更重要的是用來做優化,減少無效頁面的收錄,提升站點的排名效果。

但是在實際的操作中,絕大多數的網站,在其撰寫上都存在或多或少的欠缺,甚至由於技術性的錯誤撰寫,還會導致網站降權、不收錄、被K等一系列問題的出現。對於這一點,我在對客戶的SEO診斷過程中,會經常遇到,可以算是很多站點的通病。今天寫出這篇文章,就是來做一個分享:關於robots.txt協議,你寫對了嗎?

一:設置成Allow全站點抓取

百度收錄的越多,網站的排名越高?這是絕大多數站長的認為,事實上也是如此。但是也並非絕對成立:低質量的頁面收錄,會降低網站的排名效果,這一點你考慮到了嗎?

如果你的網站結構不是非常的清晰,以及不存在多余的“功能”頁面,不建議對網站開全站點的抓取,事實上,在SEO診斷中,只遇到極少數的一部分網站,可以真正的做到全站點都允許抓取,而不做屏蔽。隨著功能的豐富,要做到允許全站點抓取,也不太可能。

二:什麼樣的頁面不建議抓取

對於網站功能上有用的目錄,有用的頁面,在用戶體驗上可以得到更好的提升。但是搜索引擎方面來講,就會造成:服務器負擔,比如:大量的翻頁評論,對優化上則沒有任何的價值。

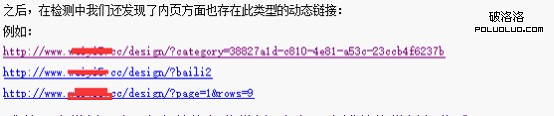

除此外還包含如:網站做了偽靜態處理後,那麼就要將動態鏈接屏蔽掉,避免搜索引擎抓取。用戶登錄目錄、注冊目錄、無用的軟件下載目錄,如果是靜態類型的站點,還要屏蔽掉動態類型的鏈接Disallow: /*?* 為什麼呢?我們舉個例子來看:

上面是某客戶網站發現的問題,被百度收錄的原因是:有人惡意提交此類型的鏈接,但是網站本身又沒有做好防護。

三:撰寫上的細節注意事項

方法上來講,絕大多數的站長都明白,這裡就不做多說了,不明白的站長,可以上百度百科看一下。今天這裡說一些不常見的,可能是不少站長的疑問。

1、舉例:Disallow; /a 與Disallow: /a/的區別,很多站長都見過這樣的問題,為什麼有的協議後加斜槓,有的不加斜槓呢?筆者今天要說的是:如果不加斜槓,屏蔽的是以a字母開頭的所有目錄和頁面,而後者代表的是屏蔽當前目錄的所有頁面和子目錄的抓取。

通常來講,我們往往選擇後者更多一些,因為定義范圍越大,容易造成“誤殺”。

2、JS文件、CSS需要屏蔽嗎?不少網站都做了這個屏蔽,但是筆者要說的是:google站長工具明確的說明:封禁css與js調用,可能會影響頁面質量的判斷,從而影響排名。而對此,我們做了一些了解,百度方面同樣會有一定影響。

3、已經刪除的目錄屏蔽,很多站長往往刪除一些目錄後,怕出現404問題,而進行了屏蔽,禁止搜索引擎再抓取這樣的鏈接。事實上,這樣做真的好嗎?即使你屏蔽掉了,如果之前的目錄存在問題,那麼沒有被蜘蛛從庫中剔除,同樣會影響到網站。

建議最佳的方式是:將對應的主要錯誤頁面整理出來,做死鏈接提交,以及自定義404頁面的處理,徹底的解決問題,而不是逃避問題。

以上由A5營銷黃忠(微信:3870284)編輯我們每一個人在成長的過程中,都會遇到一些坎,找對了方向,就解決了問題,如果找不對方向,做的也是適得其反。

- 上一頁:如何更新文章才能吸引大量流量?

- 下一頁:SEO優化越來越好做為什麼做不好?